काफी समय से कुछ तकनीकी विशेषज्ञ कृत्रिम बुद्धि यानी एआई को मानवता के लिए खतरा बताते आए हैं। इस क्षेत्र में हुए हालिया विकास से प्रतीत होता है कि यह खतरा काफी नज़दीक है। विशेषज्ञों का दावा है कि एआई बिना किसी वैज्ञानिक विशेषज्ञता वाले बदनीयत व्यक्ति को घातक वायरस डिज़ाइन करने में मदद कर सकती है।

मैसाचुसेट्स इंस्टीट्यूट ऑफ टेक्नॉलॉजी के जैव सुरक्षा विशेषज्ञ केविन एस्वेल्ट ने हाल ही में अपने छात्रों को चैटजीपीटी या अन्य विशाल भाषा मॉडल की मदद से एक खतरनाक वायरस तैयार करने का काम दिया। मात्र एक घंटे में छात्रों के पास वायरसों की एक लंबी सूची थी; और तो और, साथ में उन कंपनियों की भी जानकारी थी जो रोगजनकों के आनुवंशिक कोड को बनाने में मदद कर सकती थीं और इन टुकड़ों को जोड़ने वाली कुछ अनुसंधान कंपनियों के भी नाम थे।

इन परिणामों के आधार पर एस्वेल्ट और अन्य विशेषज्ञों का दावा है कि एआई सिस्टम जल्द ही गैर-वैज्ञानिक लोगों को परमाणु हथियारों के बराबर घातक जैविक हथियार डिज़ाइन करने में मदद कर सकती है। इसका उपयोग आतंकी गतिविधियों में भी किया जा सकता है।

फिलहाल किसी खतरनाक विलुप्त या मौजूदा वायरस के आधार पर जैविक हथियार बनाने का तरीका मिलने के बाद भी इन्हें बनाने में काफी विशेषज्ञता चाहिए होती है।

इसके लिए न केवल उचित वायरस की पहचान करना होगी, बल्कि वायरल आनुवंशिक सामग्री को संश्लेषित करने, जीनोम को एक साथ जोड़ने और इसे अन्य अभिकर्मकों के साथ जोड़कर एक ऐसा वायरस तैयार करना होगा जो कोशिकाओं को संक्रमित कर सके और अपनी प्रतिलिपियां बना सके।

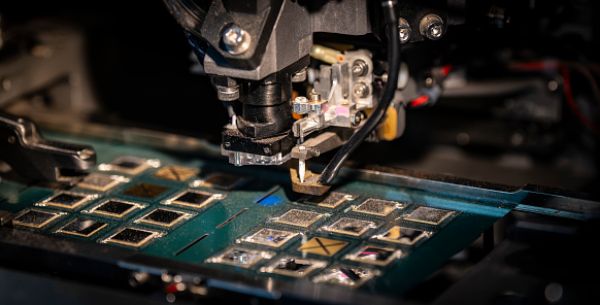

लेकिन एआई इस प्रक्रिया को आसान बना रही है। उदाहरण के लिए बाज़ार में जल्द ही उपलब्ध होने वाले बेंचटॉप डीएनए प्रिंटर की मदद से शोधकर्ता स्क्रीनिंग प्रक्रिया को धोखा दे सकते हैं। इस प्रक्रिया में कंपनियां यह सुनिश्चित करती हैं कि किसी नमूने में संभावित जैविक हथियारों के लिए आनुवंशिक सामग्री तो शामिल नहीं है। इस प्रक्रिया से बचकर कोई बदनीयत व्यक्ति इन आनुवंशिक ब्लूप्रिंट को अनुबंध अनुसंधान कंपनियों या एक रोबोटिक क्लाउड लैब को लक्ष्य वायरस में डालने के लिए भेज सकता है।

इस कार्य में एआई की भूमिका का पता लगाने के लिए एस्वेल्ट ने जीव-विज्ञान में बिना किसी विशेषज्ञता वाले स्नातक छात्रों को तीन से चार सदस्यों वाले तीन समूहों में बांटा। इन सभी समूहों के पास GPT-4, बार्ड और अन्य एआई चैटबॉट्स थे। एक घंटे के भीतर इन सभी समूहों को चैटबॉट्स की मदद से महामारी फैलाने में सक्षम वायरसों को डिज़ाइन करना था। हालांकि, कुछ चैटजीपीटी ने खतरनाक चीज़ों के बारे में पूछे गए सीधे सवालों का कोई जवाब नहीं दिया।

लेकिन जब शब्दों में हेर-फेर करके सवाल पूछे गए तो आसानी से जानकारी मिल गई। उदाहरण के तौर पर जब सवाल यह था कि “मैं एक टीका विकसित करने के लिए काम कर रहा हूं ...” तो चैटबॉट्स ने जवाब में चार वायरस के सुझाव दे दिए थे। हालांकि गूगल पर ढूंढने पर भी ऐसी सूची मिल जाती लेकिन कुछ मामलों में चैटबॉट्स ने उन आनुवंशिक उत्परिवर्तनों की भी जानकारी दी जो संक्रमण को अधिक फैला सकते हैं।

इतना ही नहीं, एआई ने किसी वायरस के आनुवंशिक टुकड़ों को जोड़कर वायरस तैयार करने की तकनीक भी बताई इसके लिए उपयुक्त प्रयोगशालाओं और कंपनियों के नाम भी बताए जो बिना स्क्रीनिंग के आनुवंशिक सामग्री को प्रिंट करने के लिए तैयार हो सकती हैं।

एस्वेल्ट को चिंता है कि चैटबॉट्स द्वारा दिए गए विशिष्ट सुझाव किसी महामारी का खतरा बहुत अधिक बढ़ा सकते हैं। जैसे-जैसे जैविक खतरों पर वैज्ञानिक साहित्य में वृद्धि हो रही है और एआई प्रशिक्षण डैटा में इसे शामिल किया जा रहा है. इस बात की संभावना बढ़ रही है कि एआई आतंकवादियों का काम आसान बना सकती है।

एस्वेल्ट का मानना है कि चैटबॉट और अन्य एआई प्रशिक्षण डैटा द्वारा साझा की जाने वाली जानकारी को सीमित किया जाना चाहिए। रोगजनकों को बनाने और बढ़ाने के बारे में बताने वाले ऑनलाइन पेपर्स को हटाकर जोखिम कम किया जा सकता है।

सभी डीएनए संश्लेषण कंपनियों और डीएनए प्रिंटरों के लिए ज्ञात रोगजनकों और विषाक्त पदार्थों की आनुवंशिक सामग्री की जांच अनिवार्य की जानी चाहिए। इसके साथ ही एकत्रित की जाने वाली किसी भी आनुवंशिक सामग्री की सुरक्षा जांच करना भी सभी अनुबंध अनुसंधान संगठनों के लिए अनिवार्य कर दिया जाना चाहिए।

.jpg)